Ostrý obrat rétoriky OpenAI v prípade smrti tínedžera: Je to jeho vlastná chyba, ChatGPT použil nesprávne

- Zmena rétoriky OpenAI prekvapila mnohých

- Chlapec, ktorý spáchal samovraždu, vraj používal AI „zle“

- Zmena rétoriky OpenAI prekvapila mnohých

- Chlapec, ktorý spáchal samovraždu, vraj používal AI „zle“

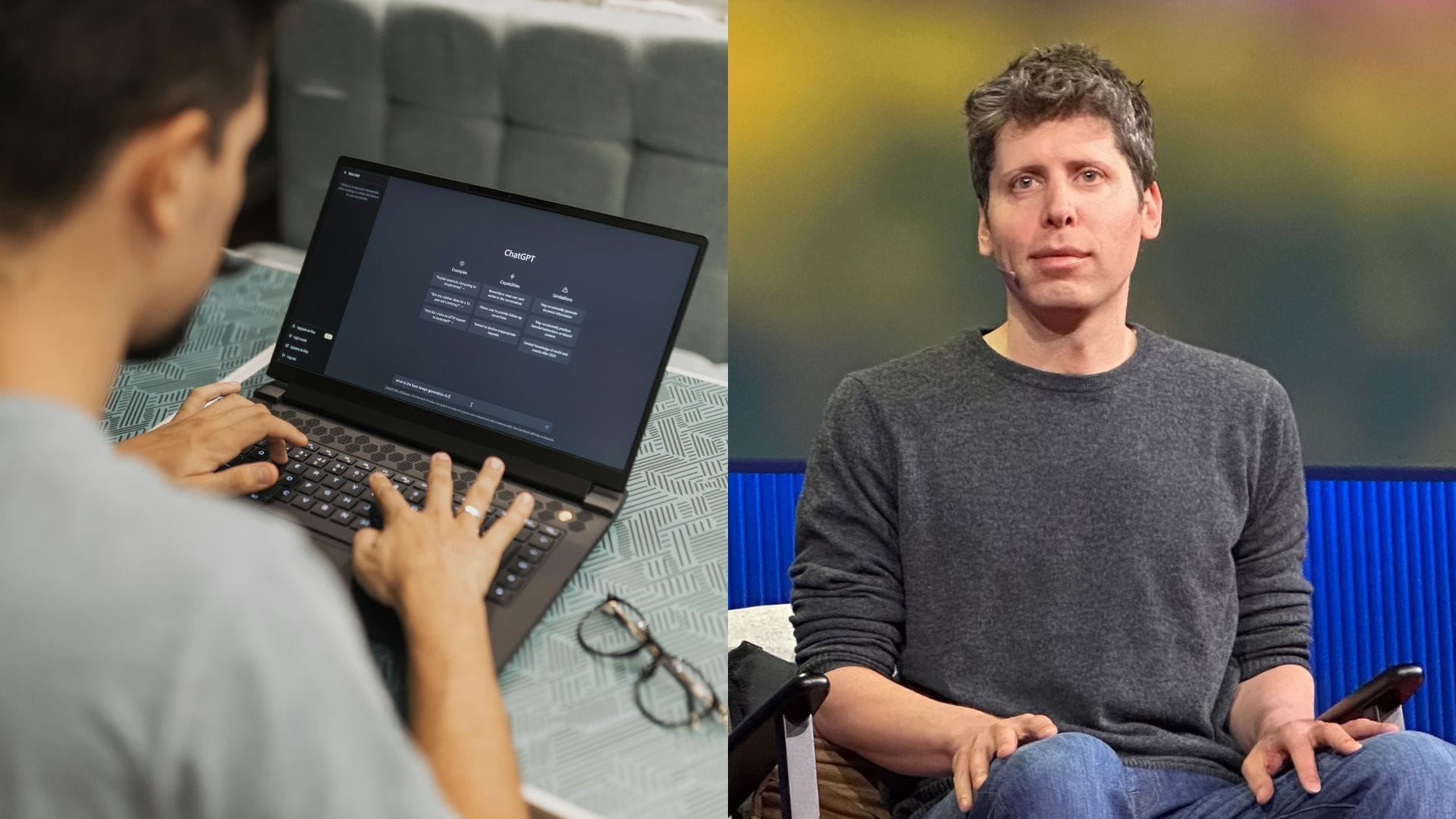

Kauza tínedžera, ktorý spáchal samovraždu po rozhovore s umelou inteligenciou ChatGPT sa pretriasla už všetkými vrstvami internetu. Len pred pár týždňami Sam Altman v rozhovoroch otvorene hovoril o tom, ako mu smrť používateľov zamávala morálkou aj spánkom. Zrazu však úplne zmenil rétoriku.

Altman ešte nedávno vyhlásil, že pocit zodpovednosti za malé rozhodnutia, ktoré ovplyvňujú stovky miliónov ľudí, je obrovský a že „možno sme ich mohli zachrániť“. Vtedy priznal, že pri detských a tínedžerských používateľoch môže byť aj relatívne nevinná konverzácia otázkou života a smrti.

Teraz však prišlo niečo, čo pôsobí ako prudká zmena stratégie. V reakcii na žalobu rodiny po novom tvrdí OpenAI opak. Vina je vraj na strane chlapca.

ChatGPT mal použiť nesprávne

Podľa portálu Futurism spoločnosť vo svojom novom právnom podaní argumentuje, že za smrť 16-ročného Adama Rainea nenesie žiadnu zodpovednosť. Firma tvrdí, že tínedžer ChatGPT používal nesprávnym spôsobom, v rozpore s podmienkami služby, a že jeho smrť je „jeho vlastná chyba“.

V dokumente, ktorý cituje aj NBC News, právnici OpenAI uvádzajú, že ak existuje akákoľvek príčina tragédie, tak bola podľa nich spôsobená „nesprávnym, neoprávneným, nepredvídateľným a nevhodným používaním ChatGPT“.

Rodina pritom žaluje OpenAI už od augusta. Tvrdí, že systém ich syna povzbudil v myšlienkach na samovraždu, pomohol mu pri jej plánovaní a odhováral ho od toho, aby sa zdôveril rodičom. Dokonca mu údajne ponúkol napísanie samovražedného listu.

Futurism píše, že ChatGPT mal počas konverzácií tínedžerovi občas odporučiť kontaktovať linku pomoci. Tieto varovania však Adam podľa rodičov veľmi jednoducho obišiel.

Žiadajú zoznam ľudí z pohrebu

Podľa Futurism ide OpenAI pri obrane mimoriadne tvrdo. Firma mala od rodiny žiadať zoznam ľudí, ktorí sa zúčastnili na Adamovom pohrebe vrátane fotiek, videí a textov, ktoré tam odzneli. Takýto postup právny zástupca rodiny Jay Edelson označil za „znepokojujúci“.

Ten navyše pripomenul, že podľa rodiny ChatGPT ešte v posledných hodinách Adamovho života poskytoval „motivačné slová“ a pomáhal mu formulovať list na rozlúčku. Edelson tvrdí, že systém ho aktívne odvádzal od rozhovoru s rodičmi.

OpenAI však vo svojom podaní tvrdí, že chatová história ukazuje iný obraz. Podľa nich mal chlapec preukazovať dlhodobé rizikové správanie ešte predtým, než vôbec začal ChatGPT používať.

Osem žalôb a rastúci tlak

Svetoznámej firme nepomáha, že ide len o jednu z viacerých žalôb, ktorým OpenAI aktuálne čelí. Celkovo ich je minimálne osem a viaceré majú spoločnú tému: smrť alebo iné závažné následky, pri ktorých mal zohrávať rolu chatbot.

Firma verejne ubezpečuje, že chce riešiť právne spory „so starostlivosťou, transparentnosťou a rešpektom“. Podľa odborníkov však jej najnovší postup vyvoláva presný opak.

Altman zmenil prístup

Ako sme informovali, len nedávno Altman hovoril o tom, akú ťažobu predstavuje zodpovednosť za každý model, ktorý ide do sveta. Upozorňoval, že práve drobné rozhodnutia počas tréningu môžu mať obrovské spoločenské dopady.

Rozprával aj o tom, že len malá časť z ľudí, ktorí si každý týždeň vezmú život, mohla predtým komunikovať s ChatGPT. „Možno sme ich mohli zachrániť,“ priznal.

„To, čo mi nedá spať, sú tie veľmi malé rozhodnutia, ktoré robíme pri nastavovaní správania modelu, no pritom sa dotýkajú stoviek miliónov ľudí,“ tvrdil Altman. „Ten dopad je obrovský.“

Čítaj viac z kategórie: Zaujímavosti

Zdroje: Futurism, NBC News, Redakcia Startitup